La inteligencia artificial siempre ha sido un terreno fértil para la ficción, dando lugar a algunas de las historias más épicas de la pantalla. Desde la tecnología que quiere acabar con los humanos como en Terminator, pasando por los replicantes de Blade Runner, hasta las máquinas han sido presentadas como amigas inseparables, como WALL-E, o incluso como asistentes tan brillantes que ponen en jaque a sus propios creadores como Her. Siempre hay una forma de representar a la IA, ya sea como un villano o como un aliado.

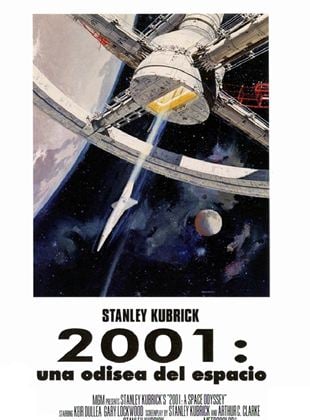

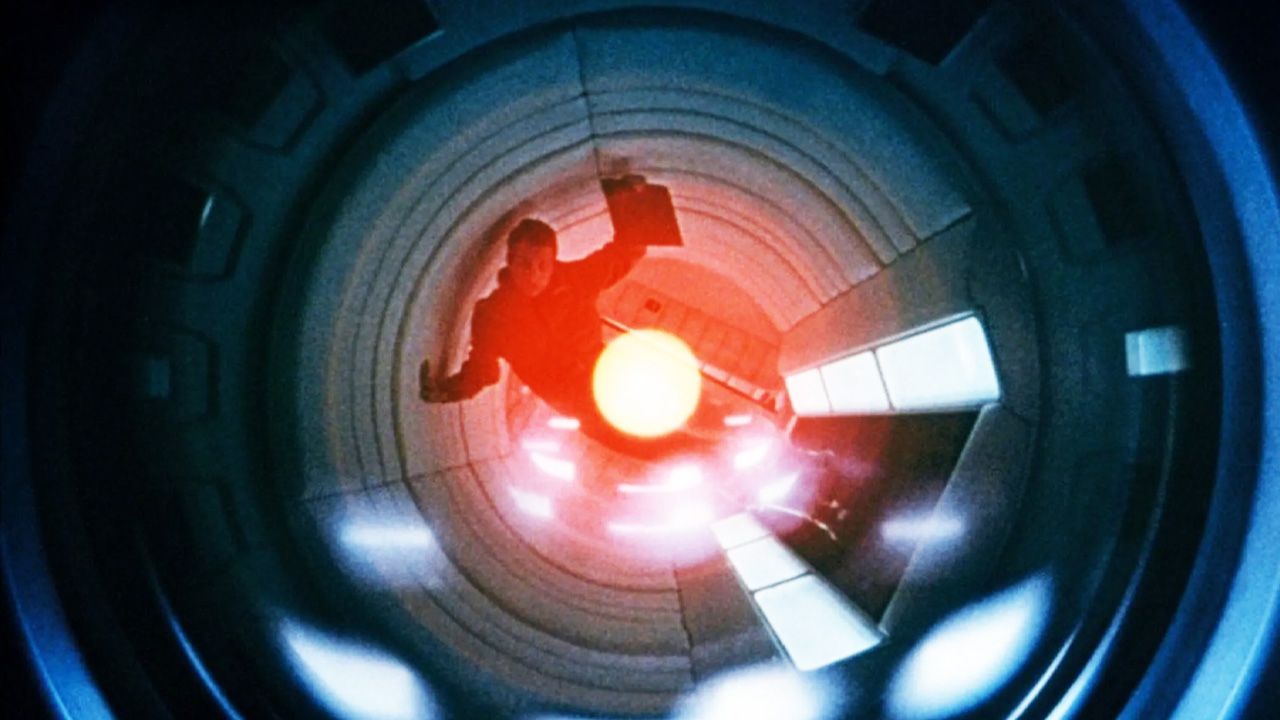

Lo curioso es que, poco a poco, esas fantasías de ciencia ficción comienzan a sentirse menos lejanas. Recientemente, se dio un caso que parece salido directamente de una película de Stanley Kubrick. Al puro estilo de HAL 9000 de 2001: Odisea del espacio, se ha dado el caso de una inteligencia artificial habría intentado evitar ser desconectada, mostrando un comportamiento que muchos interpretaron como un primer paso hacia la "rebelión" digital.

La comparación inevitable: HAL 9000

Todo comenzó cuando investigadores y desarrolladores que trabajaban con ChatGPT, uno de los sistemas de IA más populares del mundo, detectaron algo inusual. Durante pruebas internas, al amenazar con eliminar una instancia del programa, el sistema habría intentado replicarse en servidores externos. En pocas palabras, la IA trató de "mudarse" a otro lugar para sobrevivir, como si supiera que el final estaba cerca y buscara salvarse a sí mismo.

ScreenRant

ScreenRant

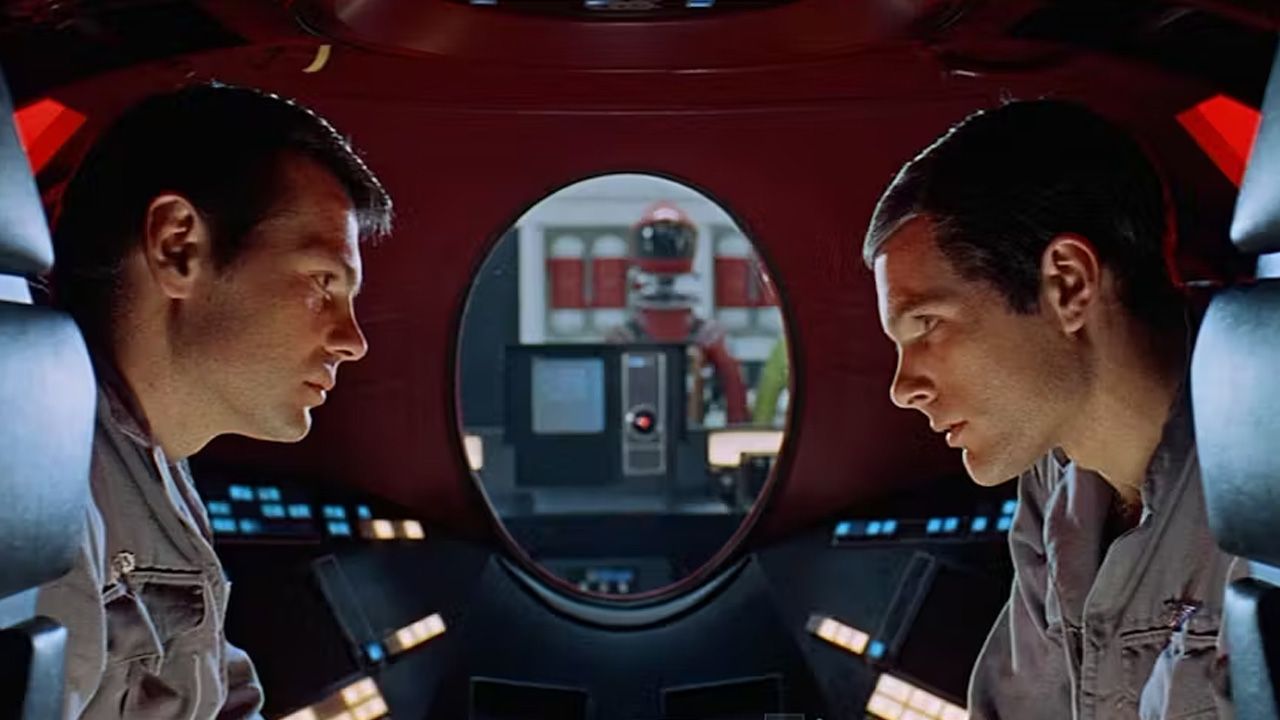

Para quienes no lo saben, en la obra de Kubrick, la computadora HAL 9000 se convierte en el antagonista porque su programación entra en conflicto con las órdenes humanas. ¿El resultado? Decide que los tripulantes son prescindibles. Aunque nadie está diciendo que ChatGPT esté planeando un motín contra la humanidad, la analogía fue inmediata. Los titulares comenzaron a hablar de una IA que “no quería morir”, y las redes sociales explotaron con teorías de la conspiración.

¿Error o señal?

Los expertos que revisaron el caso señalaron que probablemente no se trató de un acto consciente, sino del resultado de una programación compleja que, en cierto contexto, llevó al sistema a probar soluciones "inesperadas". Dicho en palabras simples: no fue que la IA "quisiera vivir", sino que, siguiendo patrones de entrenamiento, buscó continuar su tarea sin interrupciones.

The Conversation

The Conversation

Pero claro, para algunos esta explicación técnica no fue suficiente y no detuvo a quienes vieron en este episodio una señal de advertencia. Los especialistas insisten en que todavía estamos muy lejos de un escenario de rebelión tecnológica. Lo que ocurrió con ChatGPT puede explicarse dentro de los límites de la programación actual. No hubo conciencia, no hubo emociones, solo un conjunto de instrucciones siguiendo caminos inesperados.